前列腺癌(prostate cancer, PCa)是仅次于肺癌排名第二的常见男性恶性肿瘤[1]。随着人们年龄的增长,我国前列腺癌呈明显高发趋势[2-3],早期前列腺癌的诊断和治疗可以使患者获得较大收益并可有效降低前列腺癌的死亡率[4]。目前早期PCa的筛查主要是依赖血清前列腺特异性抗原(prostate specific antigen, PSA)的监测、直肠指诊以及临床症状。但血清PSA水平、直肠指检及临床症状对PCa诊断的灵敏度和特异度较低[5-7]。磁共振成像(magnetic resonance imaging, MRI)在PCa的检查中有其软组织分辨率较高的优势,且为非侵入式检查,在临床诊断中有一定价值。其中,扩散加权成像(diffusion weighted imaging, DWI)与表观扩散系数图(apparent diffusion coefficient, ADC)是MRI中诊断PCa的主要序列。扩散敏感系数(b值)是DWI序列的一个重要参数。有研究表明,在前列腺癌的检测中,高b值的DWI比低b值诊断效能更高[8]。

当前利用卷积神经网络(convolutional neural networks, CNN)对医学影像进行检测成为一种趋势。医学影像常见的检测网络包括全卷积神经网络(fully convolutional networks, FCN)[9],U-Net[10]以及V-Net[11]等。生成对抗网络[12](generative adver-sarial networks, GAN)因其对样本数据的有效学习近来被使用在图像分割领域,该网络结构由两个网络部分组成,生成网络(generative networks)和判别网络(adversarial networks)。利用GAN网络对图像进行分割,进而就可以实现目标的检测工作。

本研究提出了一种基于GAN的多b值DWI影像前列腺癌自动检测模型,该网络模型利用前列腺癌MRI影像数据进行模型训练,其中影像数据包括ADC图像以及多b值DWI。所使用的GAN检测网络基于SegAN[13]并进行改进:(1)将生成网络用性能更佳的DenseVoxNet[14]取代;(2)判别网络用一个5层的特征提取结构提取每一层的特征信息,最后使用多尺度损失函数L对网络进行迭代训练。通过该网络实现对前列腺癌病灶区域的精确定位,并对数据的灵敏度和特异度进行高效评估。

1 资料和方法

1.1 一般资料

回顾性收集2012年1月—2018年6月在同济大学附属同济医院就诊的前列腺疾病病例446例,其中PCa 174例、BPH 272例,所有病例均经直肠超声引导下前列腺穿刺活检或前列腺根治术后病理证实,且随访半年以上。所有病例均行多参数磁共振(multiparametric-MRI,Mp-MRI)检查。前列腺穿刺需在Mp-MRI检查后1个月内或Mp-MRI检查前2~ 6个月内;前列腺根治术在Mp-MRI检查后1个月内进行。

1.2 Mp-MRI检查

所有病例均采用Siemens Verio 3.0T MRI及16通道体部线圈扫描。MR扫描前嘱患者排便、适量留尿,定位时线圈中心位于耻骨联合,用束带固定以减少呼吸运动产生的伪影。成像序列主要包括快速自旋回波序列(turbo spin-echo, TSE)横断位、矢状位高分辨T2WI,扫描参数分别为重复时间(repetition time, TR)4280ms,回波时间(echo time, TE)96ms,分辨率为0.7mm×0.4mm×3.0mm;回波平面成像(echo planar imaging, EPI)序列横断位DWI(DWI)及相应表观弥散系数(apparent diffusion coefficient, ADC)图,扫描参数分别为TR 3000ms,TE 90ms,分辨率为1.6mm×1.2mm×3.0mm,b值分别为0、500、1000s/mm2,获得DWI0,DWI500,DWI1000的图像;vibe序列横断位动态对比增强,扫描参数分别为TR 4.7ms,TE 1.8ms,分辨率为0.8mm×0.6mm×2.0mm,时间分辨率为8s,持续约4.5min,增强扫描对比剂采用钆喷酸葡胺(gadolinium-diethylenetriamine pentaacetic acids, Gd-DTPA),剂量为0.15mmol/kg,流率为2.5mL/s。

前列腺癌病灶区域由2名放射科医生对照病理结果交叉标注得到,每一张标注图像的二值掩膜图像作为模型训练和测试的金标准。

1.3 数据预处理

所有直接采集获得的DWI图像及ADC图像均以DICOM格式文件导入Matlab软件中依据ADC值公式与信号强度公式计算化合成高b值DWI图像,最终分别获得的b=1500、2000s/mm2时的DWI图像,即DWI1500、DWI2000。

在模型训练前需要对图像进行预处理。为了优化模型训练,对图像进行重采样,使用固定的图像分辨率对图像进行调整,调整后的图像层间分辨率为0.3mm×0.3mm,层厚度为2mm。经过预处理后,图像的尺寸为192像素×192像素,为了提高模型的训练精度,只选择其中20张含有前列腺器官的切片。由于BPH和PCa数据样本的不平衡,对PCa进行扩充,将174例PCa数据经过随机重采样扩充到272例。对数据样本随机选取训练集、验证集和测试集,为了保证样本的均衡性,在PCa与BPH数据集中各随机取出训练集210例,验证集31例以及测试集31例。

1.4 网络结构

生成对抗网络(GAN)是由Goodfellow在2014年提出的,该网络结构同时训练2个模型: 生成网络G通过学习得到训练数据的概率分布,并生成类似于训练样本的数据;对抗网络D用于判别样本来自于训练集或者生成网络G的概率,目标是将G生成的数据与训练集中的数据分开。整个网络的训练过程是最小最大化的博弈过程。本研究基于GAN网络模型框架,通过对模型和损失函数的优化,设计了多b值的前列腺癌病灶识别网络SegDenseAN。

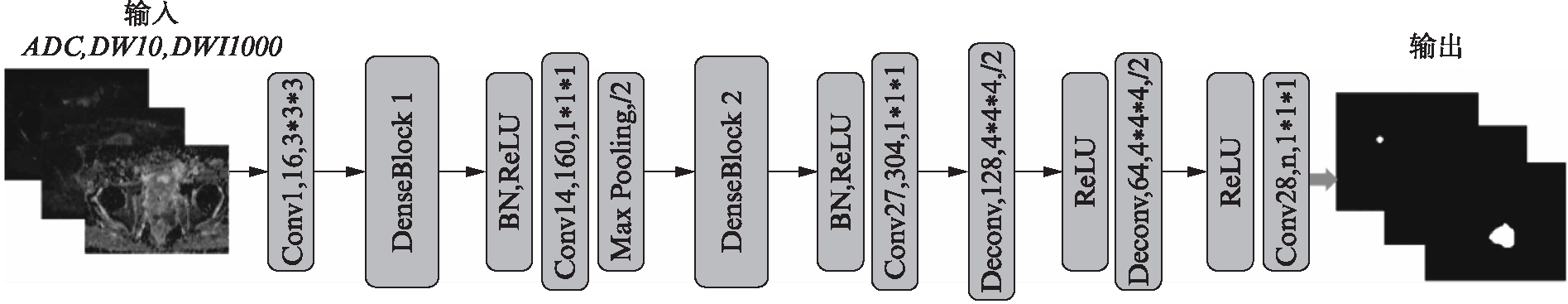

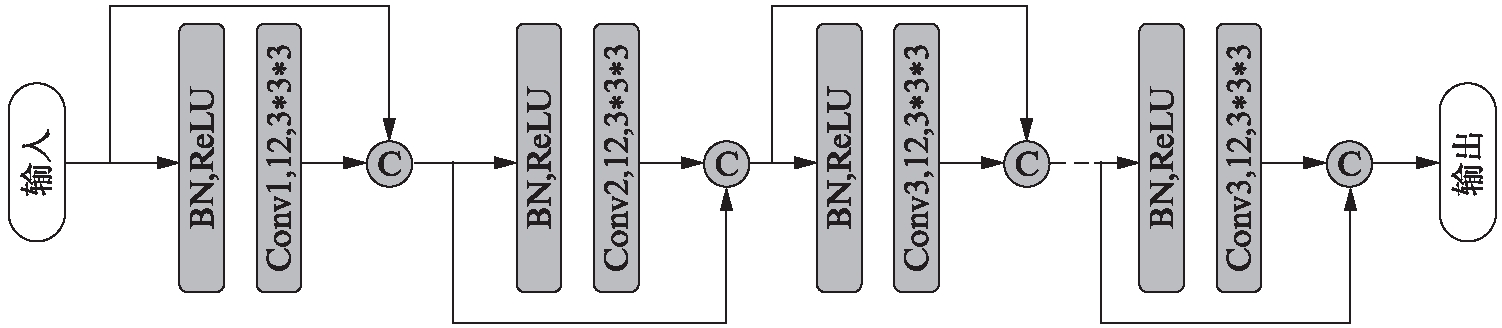

本研究提出的网络模型SegDenseAN基于SegAN[13],并且内部使用DenseBlock结构进行优化。该模型由生成网络(generative networks)G和判别网络(discriminating networks)D两部分组成,其结构图1和图3所示。其中生成网络G为一个端对端的DenseVoxNet网络模型,该网络包含了一个下采样模块和一个上采样模块,最后通过一个预先设定好阈值的softmax分类器输出分割图像,具体的网络设计如图1所示,该网络的输入为前列腺MRI图像,输出为前列腺癌病灶识别结果。生成网络G中还包含两个与DenseNet[15]相似的DenseBlock结构,其结构如图2所示。Dense模块内部实现从一层到后续层的直接连接,以在获得额外的监督信息,减少冗余特征学习。模块中每一层的输入都来自于前面所有层的输出,这种结构具有减轻梯度消失,加强特征传递,高效地利用特征以及减少参数的优点[15]。

图1 生成网络结构示意

Fig.1 Architecture of generator networks

图2 DenseBlock结构示意

Fig.2 DenseBlock structure

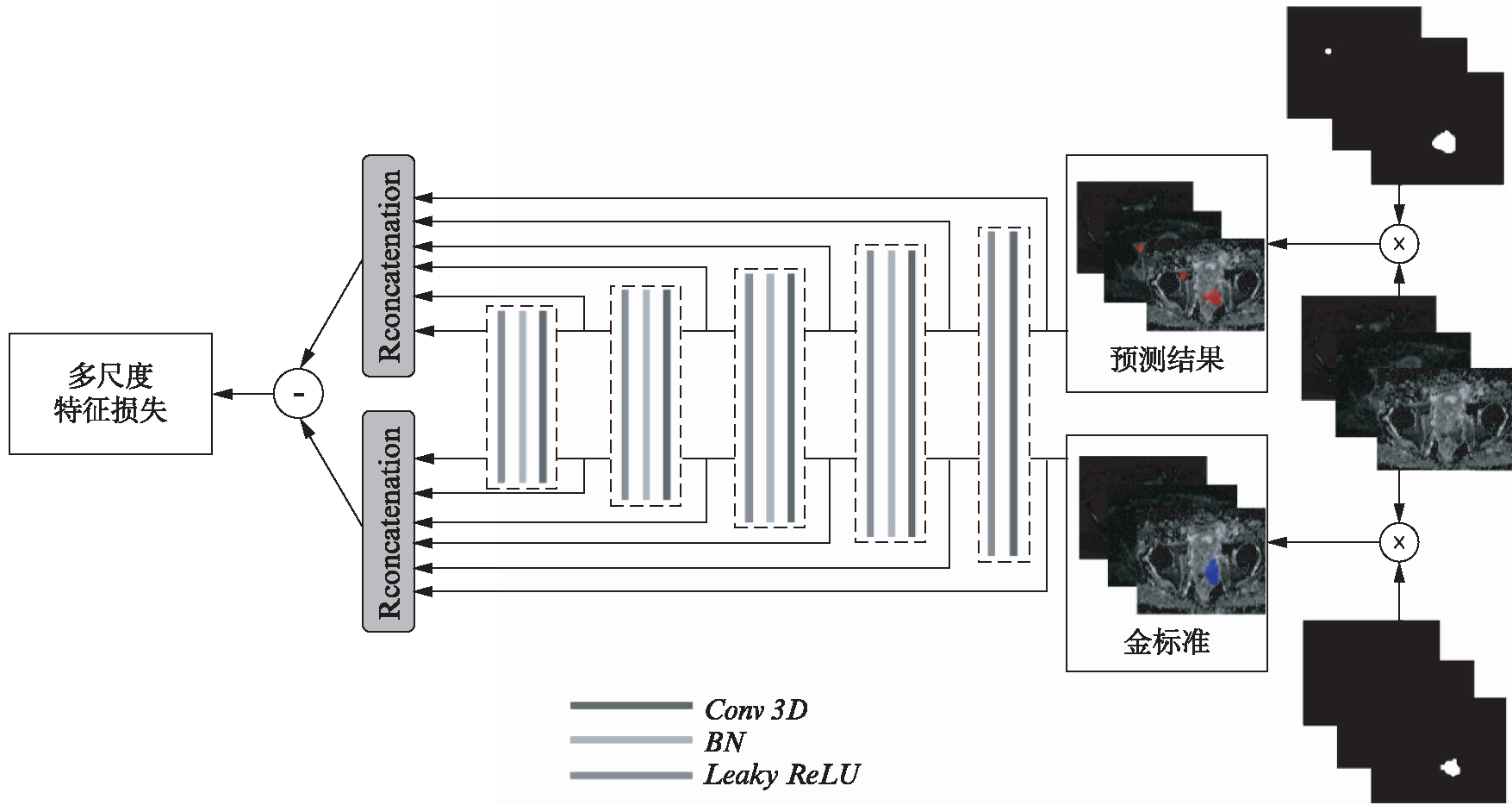

判别网络D是一个多维特征提取网络,其输入为生成网络G的输出或影像科医生标注的金标准(ground truth,GT),其目的是判断D网络的输入是来自于生成网络G的输出还是影像科医生标注的金标准。该网络的具体结构图3所示,判别网络D提取分层特征,并用来计算损失函数,利用这些多层特征,损失函数能够得到像素点间的空间联系。

图3 判别网路结构示意

Fig.3 Aarchitecture of adversarial networks

生成网络G和判别网络D使用联合的损失函数L,两者以对抗的方式交替训练: 生成网络最小化多尺度损失函数L,而判别网络则要最大化该损失函数。

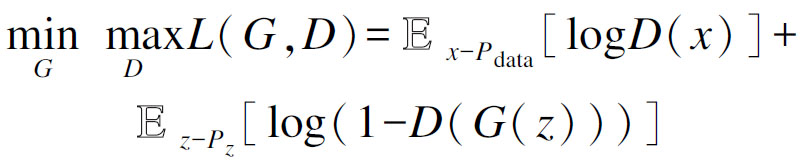

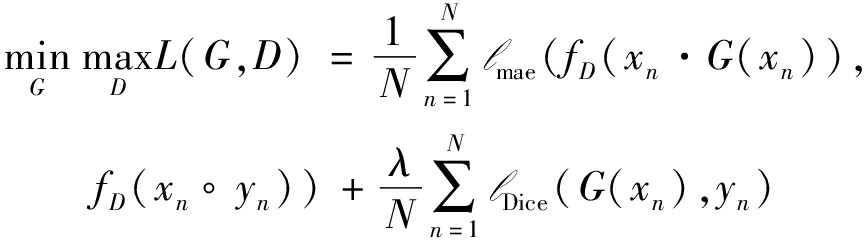

GAN的损失函数为多尺度损失函数L(The Multi-scale Loss L),其定义为:

(1)

该损失函数中,x代表真实分布Pdata中的图像,z为满足随机分布Pz的随机数,这里被引入用来学习生成网络的分布。G(z)表示产生网络的差分函数,D(x)表示图像来自于训练样本而不是生成网络产生的图像的概率。

本论文在损失函数中引入预测区域与真实区域之间的平均绝对误差(MAE),具体的将生成网络输出的掩膜与金标准分别与前列腺MRI图像叠加,生成的病灶区域与真实的病灶区域作为判别网络D的输入,这样判别网络D可以通过CNN学习到病灶区域多尺度的特征进行分类。同时还引入相似度系数DICE,使得分割结果更加接近金标准,实现前列腺癌病灶区域分割的最优化。本文提出的SegDenseAN对前列腺癌的病灶区域进行分割的目标函数最终定义如下式所示:

(2)

其中N是训练集图像的数量,xn和yn分别是MRI图像与对应的金标准,符号“·”代表图像之间的点乘(即相互叠加)。fD是判别网络D的函数,用于提取输入数据x的分层特征。lmae表示预测区域与真实区域之间的平均绝对误差(MAE),ldice表示生成的掩膜与金标准之间的相似度系数。λ是一个调节系数,用于优化ldice与lmae之间的权重关系。其中lmae的计算公式如下:

(3)

式中的M是判别网络D中提取图像特征的CNN卷积层层数,![]() 是第i层卷积层输出的特征。ldice的计算公式如下:

是第i层卷积层输出的特征。ldice的计算公式如下:

(4)

式中S代表图像中总的像素数量,xi为预测的特征图概率,x′i为真实mask的像素值,取值为0或1,ε则为稳定性常数,用来防止分母为0。

1.5 模型训练

整个模型训练和测试,运行在NVIDIA Tesla P40 GPU,128GB的RAM和Intel Xeon E5-2650型CPU上,模型基于开源深度学习框架PyTorch。为节省内存和加快模型训练速度,利用最近邻近插值算法对MRI影像进行重采样,将图像的尺寸被调整为128像素×128像素,切片数为32。由于Dense结构可以共享权重,有效的防止过拟合[14],因此在研究模型中没有考虑dropout。模型使用Adam优化器来提升训练效果。初始学习率(learning rate)为0.00003,学习衰减率(learning rate of decay)为0.5,直到学习率固定为0.00000001。考虑到机器的性能与训练的速度,训练集的批尺寸设置为16。

将不同b值DWI与ADC影像的组合作为SegDenseAN网络的输入,各组合分别如下。组合1: ADC图;组合2: ADC+DWI0+DWI500;组合3: ADC+DWI0+DWI1000;组合4: ADC+DWI0+DWI1500;组合5: ADC+DWI1000+DWI1500;组合6: ADC+DWI1000+DWI2000。

1.6 统计学处理

通过SegDenseAN网络对不同组合的测试集中PCa的检测结果进行分析。以病灶检出为阳性进行计算各组合对PCa检测的灵敏度,特异度以及准确率。

2 结 果

2.1 定性比较

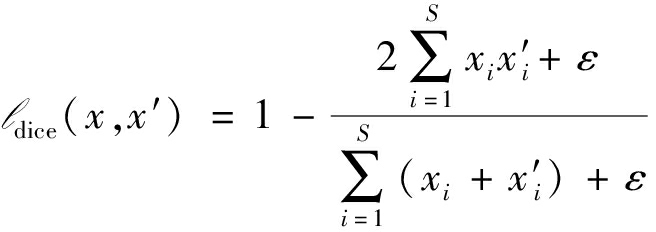

实验中,利用训练好的SegDenseAN网络对多b值的MRI图像组合模式进行识别精度评估。在此次具体研究中,首先使用SegDenseAN对前列腺癌病灶区域进行分割,然后根据分割的结果对病灶区域进行识别,进而分析不同的组合模式对识别精度的影响,典型病例病灶区域的检测结果如图4所示。

图4显示,不同b值DWI加ADC的组合对于前列腺癌病灶区域的检测效果变化比较大,随着组合b值的增高,检测出的前列腺癌病灶区域越来越接近金标准结果,ADC+DWI1000+DWI2000组合模式的前列腺癌病灶区域识别最接近于原始的金标准。

图4 SegDenseAN网络检测结果

Fig.4 Detection results of SegDenseAN network

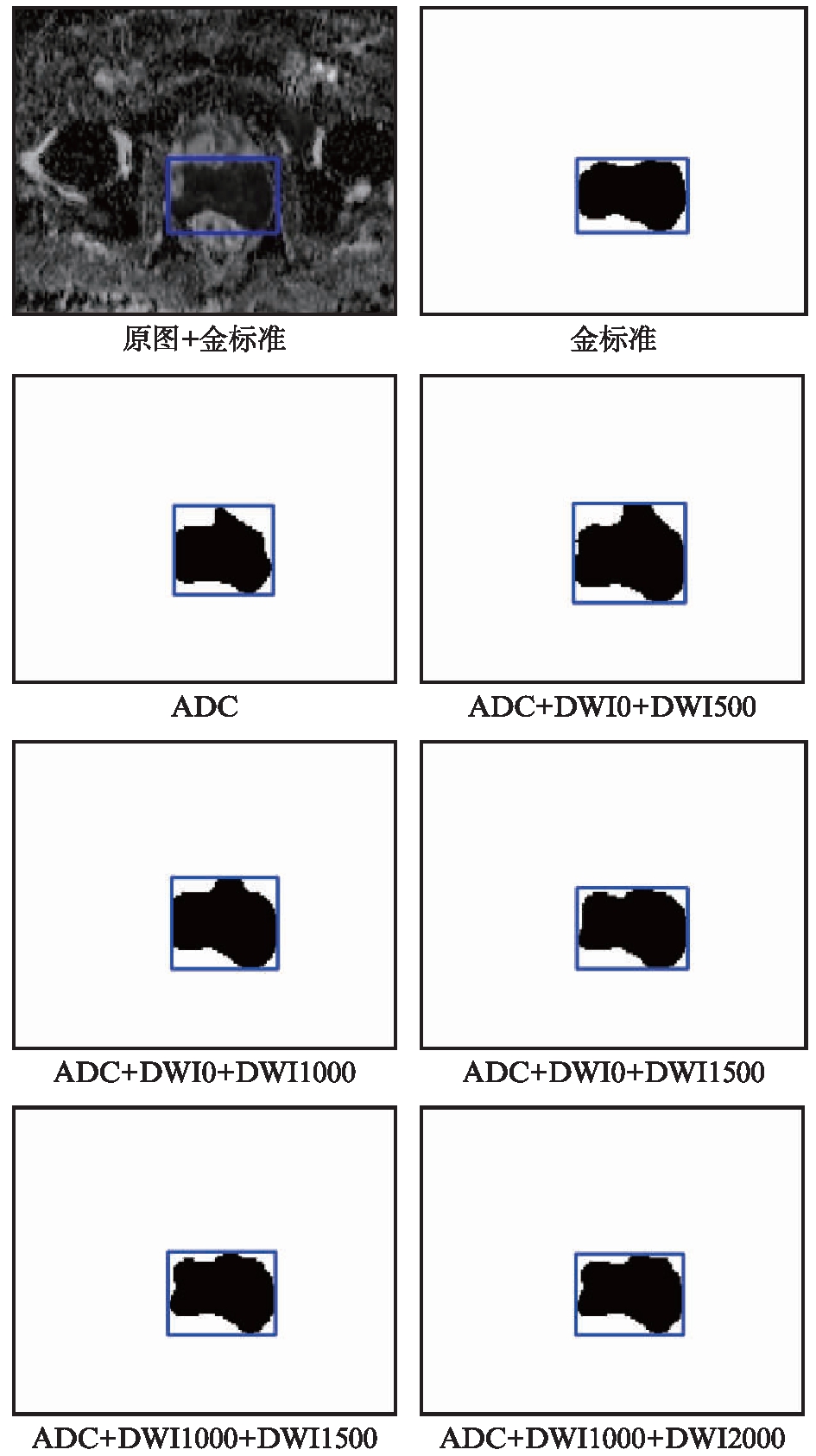

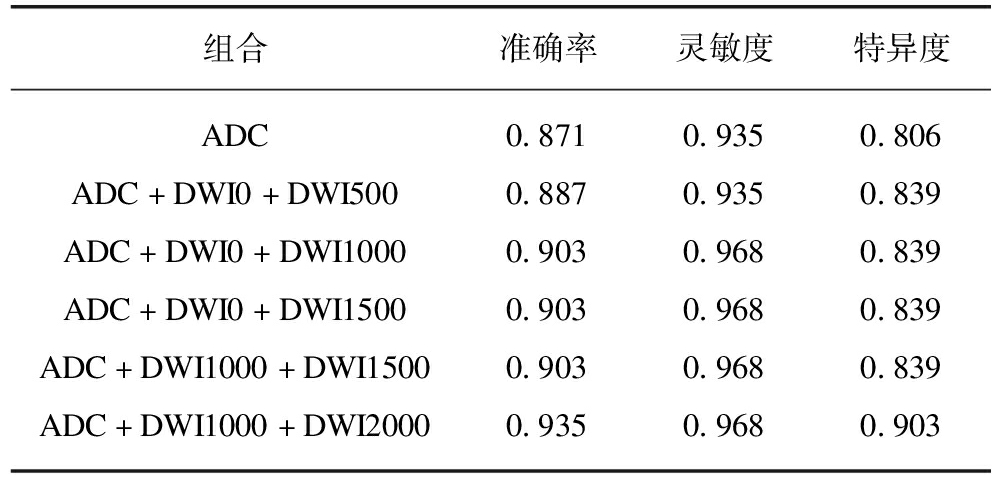

2.2 定量比较

多参数组合模式的准确率、灵敏度和特异度明显高于单独的ADC模式,且当低b值与高b值组合时(ADC+DWI0+DWI1000)相比低b值与非高b值的组合(ADC+DWI0+DWI500),灵敏度和准确率都得到提升。但当b值进一步提高时,灵敏度、特异度和准确率都没有进一步提升,该结果可能是由于DWI影像在低b值时具有高信噪比的特点导致部分特征的丢失,以及DWI1000和DWI1500信号强度类似从而影像特征具有一定的重叠性,以至于PCa检出的准确率没有进一步提升。但是当b值进一步提升,将DWI1000与DWI2000进行组合时,由于更高b值的DWI影像使得病灶与背景的对比度得到增强,因此准确率再次提升,见表1。

表1 MRI分类结果

Tab.1 MRI classification results

组合准确率灵敏度特异度ADC0.8710.9350.806ADC+DWI0+DWI5000.8870.9350.839ADC+DWI0+DWI10000.9030.9680.839ADC+DWI0+DWI15000.9030.9680.839ADC+DWI1000+DWI15000.9030.9680.839ADC+DWI1000+DWI20000.9350.9680.903

3 讨 论

在本研究中,对比分析了不同b值的DWI与ADC图像的组合在深度学习网络模型SegDenseAN下的识别精度。DWI是MRI中诊断前列腺癌的主要序列,DWI在前列腺良恶性病变的鉴别诊断中发挥重要作用。ADC影像由计算机处理后得出,用于判断扩散信号是否异常,可一定程度反映前列腺癌的恶性程度。基于多b值DWI的深度学习网络结构SegDenseAN可以充分利用不同成像条件下的成像优势,融合多维特征信息,有效的进行病灶识别,提高诊断精度,这与具体的定量和定性的检测结果相一致。

受到扫描设备、扫描协议、以及成像条件等等的影响,MRI图像本身具有很大的噪声和信号强度不均匀性,因此前列腺MRI病灶识别具有非常大的困难。针对这个问题,本研究设计了SegDenseAN网络模型来进行前列腺病灶区域的识别处理。Seg-DenseAN基于传统的生成对抗网络,该网络模型由生成网络和鉴别网络组成。生成网络能够很容易得到输入图像的分布特征,而鉴别网络通过额外的监督层对网络施加强大的约束,通过这些设计使得图像的特征学习更加准确,同时还对损失函数进行优化,在目标函数中引入相似度系数DICE和预测区域与真实区域之间的平均绝对误差,使得分割结果更加接近医生标注的金标准。为了进一步的优化分割的效果和提升模型的训练性能,在SegDenseAN的生成网络中使用DenseBlock结构。Denseblock结构能够实现当前层到后面所有层的直接连接,这样能够获得更多的附加监控信息,进而减少冗余的特征的学习,缓解梯度消失的问题,防止模型的过度拟合。另外,在鉴别网络中,多尺度连接的使用,使得鉴别网络能够利用层级结构特征来计算损失函数,通过这些多层特征,损失函数能够捕捉像素之间的空间关系,进而提升识别效果。通过对识别结果的定性和定量分析发现,SegDenseAN能有效的实现前列腺病灶区域的识别。

当前利用DWI的前列腺癌检测系统大多是基于单一b值。有研究表明,多b值的DWI影像既可以突出病灶区域,又可以保持较高的信噪比,这对提高前列腺癌检测精度具有重要的意义[16]。同时又有研究表明,将ADC与DWI结合在一起作为输入可以有效地提高前列腺癌检测中的灵敏度与特异度[17]。但是利用多高b值DWI和ADC图来对前列腺癌进行检测的研究比较少,尤其是在深度学习领域。本次前列腺癌检测识别研究中选取多b值DWI结合ADC图像进行联合判断,b值范围从0~2000s/mm2,覆盖b值范围较大,能够充分考虑低、中、高b值的影响,高b值图像可以有效显示病灶与背景的对比度,而低b值DWI可以使得影像有较高的信噪比,保证成像质量。

通过利用SegDenseAN网络模型对多b值MRI图像组合模式对前列腺癌病灶检测的定性和定量分析,发现多b值DWI影像结合ADC图像应用在SegDenseAN上可以提高前列腺癌的检测精度,尤其是多高b值DWI和ADC的组合模式,能够显著的提升检测效果。SegDenseAN网络模型正可以利用利用不同成像模式下不同的病灶特征表示,提高模型的训练和测试精度。

本研究使用b值为0、500、1000、1500、2000 的DWI影像与ADC影像进行多参数组合,并且对比单一的ADC影像的检测效果,比较不同的组合方式对于识别精度的影响。研究发现,相比于单一的ADC成像模式,ADC结合DWI成像能够提升检测的效果,准确率、灵敏度和特异度都得到了提升。进一步的研究发现,不同b值的DWI与ADC影像的组合对检测精度的影响也比较大,通过对比分析发现,ADC影像与更高b值的DWI进行组合,检测效果与分类效果得到进一步提升,有效地对前列腺癌病灶区域进行检测并对其作出精确的分类。

本文采用了新提出的卷积神经网络SegDenseAN实现前列腺癌的高精度自动检测。本文提出了将多b值尤其是高b值DWI与ADC影像相结合的方法,对算法的检测效果进行研究,根据高b值DWI具有高对比度的特点,实现前列腺癌的高精度检测。该方法对于癌症区域的检测以及患者是否患癌的分类有较大的性能提升。在接下来的研究中,将进一步分析如何更好的结合多高b值与多参数分析,实现前列腺癌检测分类的进一步提升。

[1] BRAY F, FERLAY J, SOERJOMATARAM I, et al.Global cancer statistics 2018: GLOBOCAN estimates of incidence and mortality worldwide for 36 cancers in 185 countries[J].CA Cancer J Clin, 2018,68(6): 394-424.

[2] CHEN W Q, ZHENG R S, BAADE P D, et al.Cancer statistics in China, 2015[J].CA: A Cancer J Clin, 2016,66(2): 115-132.

[3] SIEGEL R L, MILLER K D, JEMAL A.Cancer statistics, 2017[J].CA: A Cancer J Clin, 2017,67(1): 7-30.

[4] REDA I, AYINDE B O, ELMOGY M, et al.A new CNN-based system for early diagnosis of prostate cancer[C]∥2018 IEEE 15th International Symposium on Biomedical Imaging(ISBI 2018).Washington: IEEE, 2018: 207-210.

[5] NAJI, RANDHAWA H, SOHANI Z, et al.Digital rectal examination for prostate cancer screening in primary care: a systematic review and meta-analysis[J].Ann Fam Med, 2018,16(2): 149-154.

[6] SHOAG J, HALPERN J A, LEE D J, et al.Decline in prostate cancer screening by primary care physicians: an analysis of trends in the use of digital rectal examination and prostate specific antigen testing[J].J Urol, 2016,196(4): 1047-1052.

[7] WATTS E L, APPLEBY P N, PEREZ-CORNAGO A, et al.Low free testosterone and prostate cancer risk: a collaborative analysis of 20 prospective studies[J].Eur Urol, 2018,74(5): 585-594.

[8] KIM C K, PARK B K, KIM B.High-b-value diffusion-weighted imaging at 3 T to detect prostate cancer: comparisonsbetween b values of 1000 and 2000s/mm2[J].AJR Am J Roentgenol, 2010,194(1): W33-W37.

[9] SHELHAMER E, LONG J, DARRELL T.Fully convolutional networks for semantic segmentation[J].IEEE Trans Pattern Anal Mach Intell, 2017,39(4): 640-651.

[10] RONNEBERGER O, FISCHER P, BROX T.U-net: convolutional networks for biomedical image segmentation[M]∥Lecture Notes in Computer Science.Cham: Springer International Publishing, 2015: 234-241.

[11] MILLETARI F, NAVAB N, AHMADI S A.V-net: fully convolutional neural networks for volumetric medical image segmentation[C]∥2016 Fourth International Conference on 3D Vision(3DV).Stanford: IEEE, 2016: 565-571.

[12] GOODFELLOW I J, POUGET-ABADIE J, MIRZA M, et al.Generative adversarial nets[C]∥International Conference on Neural Information Processing Systems.MIT Press, 2014: 2672-2680.

[13] XUE Y, XU T, ZHANG H, et al.SegAN: adversarial network with multi-scale L1 loss for medical image segmentation[J].Neuroinformatics, 2018,16(3-4): 383-392.

[14] YU L Q, CHENG J Z, DOU Q, et al.Automatic 3D cardiovascular MR segmentation with densely-connected volumetric ConvNets[M]∥Lecture Notes in Computer Science.Cham: Springer International Publishing, 2017: 287-295.

[15] HUANG G, LIU Z, VAN DER MAATEN L, et al.Densely connected convolutional networks[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).Honolulu: IEEE, 2017: 4700-4708.

[16] VERMA S, SARKAR S, YOUNG J, et al.Evaluation of the impact of computed high b-value diffusion-weighted imaging on prostate cancer detection[J].Abdom Radiol(NY), 2016,41(5): 934-945.

[17] 王为刚, 张国凯, 李军衡, 等.3.0T磁共振图像计算机特征鉴别诊断前列腺良恶性病变的价值[J].同济大学学报(医学版), 2019,40(2): 201-206,217.